70 procent af danske virksomheder bruger nu AI i deres daglige drift. Det viser en ny analyse fra...

Edge AI kører AI-modeller lokalt på enheder i stedet for i skyen. Forstå fordelene, anvendelserne og hvornår edge-tilgangen giver mening for din virksomhed.

Edge AI bygger på det samme fundament som al anden AI: en trænet model, der kan genkende mønstre, klassificere data eller forudsige udfald. Forskellen ligger i, hvor modellen eksekveres. I stedet for at køre på en kraftig GPU-klynge i et datacenter bliver modellen komprimeret og optimeret, så den kan køre på en lokal enhed med begrænset regnekraft.

Denne optimering sker typisk via teknikker som knowledge distillation, kvantisering og pruning, der reducerer modellens størrelse og beregningskrav uden at ofre for meget nøjagtighed. Resultatet er en model, der kan køre på en industriel sensor, et kamera eller en mobiltelefon.

Når en edge-enhed modtager data, behandler den det lokalt og leverer et resultat med det samme. Et kamera på en produktionslinje kan identificere en defekt komponent inden for millisekunder. En sensor på en vindmølle kan registrere unormale vibrationer og sende en alarm, før et nedbrud opstår. Data behøver ikke forlade enheden, hvilket reducerer latenstid drastisk sammenlignet med en cloud-baseret arkitektur.

I mange implementeringer arbejder edge og cloud sammen. Edge-enheden håndterer realtidsbeslutninger, mens aggregerede data sendes til skyen til videre analyse, modelopdatering og optimering på tværs af lokationer. Denne hybride tilgang kombinerer hastighed med skala.

Edge AI har bevæget sig fra eksperimentel teknologi til produktionskritisk infrastruktur. Ifølge nyere undersøgelser betragter over 80 procent af virksomhedsledere edge AI som centralt for deres forretningsstrategi. Teknologien anvendes allerede bredt inden for produktion, detailhandel, logistik, sundhed og energi.

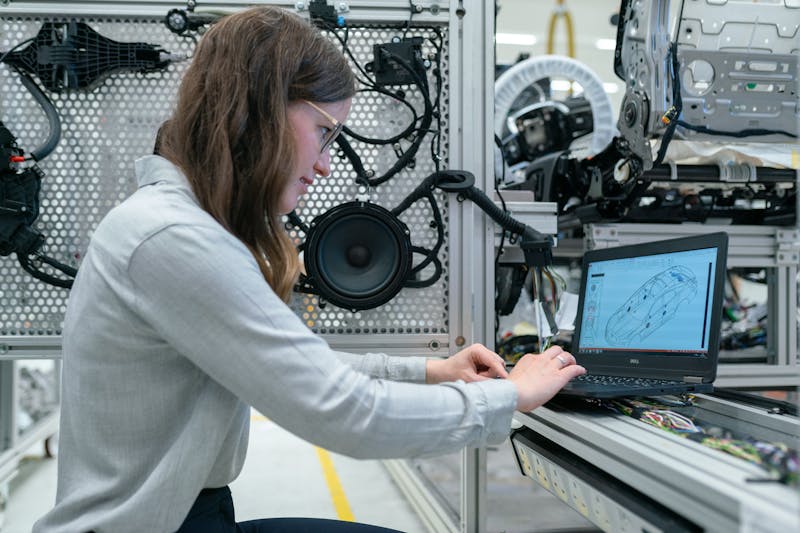

I produktionsmiljøer kører deep learning-modeller på kameraer og sensorer langs produktionslinjer til kvalitetskontrol i realtid. Defekter fanges, før produktet forlader fabrikken, og forudsigende vedligeholdelse reducerer nedetid med op til 25 procent ved at identificere maskinfejl, før de opstår.

I detailhandlen muliggør edge AI smarte kasseløsninger, automatisk lagerstyring og personaliserede kundeoplevelser direkte i butikken. Smarte hylder kan registrere, hvornår varer skal fyldes op, og analysere kundestrømme for at optimere produktplacering, alt uden at sende data ud af butikken.

Inden for logistik og transport kører edge AI på droner, autonome køretøjer og overvågningssystemer, hvor beslutninger skal træffes i brøkdelen af et sekund. I sundhedssektoren anvendes teknologien i bærbare enheder og medicinsk udstyr, der kan monitorere patienter og reagere på kritiske ændringer uden forsinkelse.

Fælles for alle disse anvendelser er, at edge AI leverer værdi, fordi den placerer intelligens der, hvor den er mest nødvendig: tæt på handlingen, i realtid og med fuld kontrol over data.

Edge AI er ikke en erstatning for cloud-baseret AI. Store sprogmodeller og komplekse træningsjobs kræver stadig den regnekraft, som kun cloud-infrastruktur kan levere. Edge AI handler om at køre inferens lokalt, ikke om at træne modeller på en sensor.

Det er heller ikke en plug-and-play-løsning. At deployere AI-modeller på distribuerede enheder kræver omhyggelig planlægning: modeller skal optimeres til den specifikke hardware, opdateringer skal rulles ud på tværs af potentielt tusindvis af enheder, og drift skal monitoreres uden den centraliserede kontrol, man har i skyen. Virksomheder, der undervurderer denne kompleksitet, risikerer at sidde fast i pilotfasen.

Endelig er edge AI ikke begrænset til IoT-sensorer og kameraer. Begrebet dækker enhver AI-inferens, der sker uden for et traditionelt datacenter, fra smartphones og robotter til enterprise-servere placeret on-premise i virksomhedens eget miljø.

Deep Learning: Den underliggende teknologi bag mange edge AI-modeller, hvor neurale netværk genkender mønstre i data.

Foundation Model: De store, prætræmnede modeller, der ofte komprimeres til edge-deployment via knowledge distillation eller kvantisering.

Inference: Processen, hvor en trænet model genererer et output baseret på nyt input, og kerneoperationen i edge AI.

LLM (Large Language Model): Store sprogmodeller, der primært kører i skyen, men som i stadig mindre varianter (SLM) også kan deployes på edge-enheder.

Small Language Model (SLM): Kompakte sprogmodeller designet specifikt til at køre effektivt på enheder med begrænset regnekraft.

Model Quantization: En teknik til at reducere en models størrelse og beregningsbehov, så den kan køre på edge-hardware.

On-premise AI: AI-systemer, der kører i virksomhedens eget datacenter, et mellemtrin mellem cloud og edge.

Cloud AI: AI-beregninger, der kører i skyen, og den mest udbredte modsætning til edge AI.