Op mod 56 % af alle Google-søgninger ender i dag uden et eneste klik. For B2B-virksomheder, der har...

Human-in-the-Loop (HITL) sikrer menneskelig kontrol over AI-systemer. Forstå hvordan HITL fungerer, hvornår det er nødvendigt, og hvad det kræver i praksis.

HITL dækker over flere forskellige roller, som et menneske kan have i forhold til et AI-system. Den mest grundlæggende er dataannotering: mennesker mærker, kategoriserer og validerer de data, som modellen trænes på. Kvaliteten af denne proces afgør direkte, hvor præcis modellen bliver.

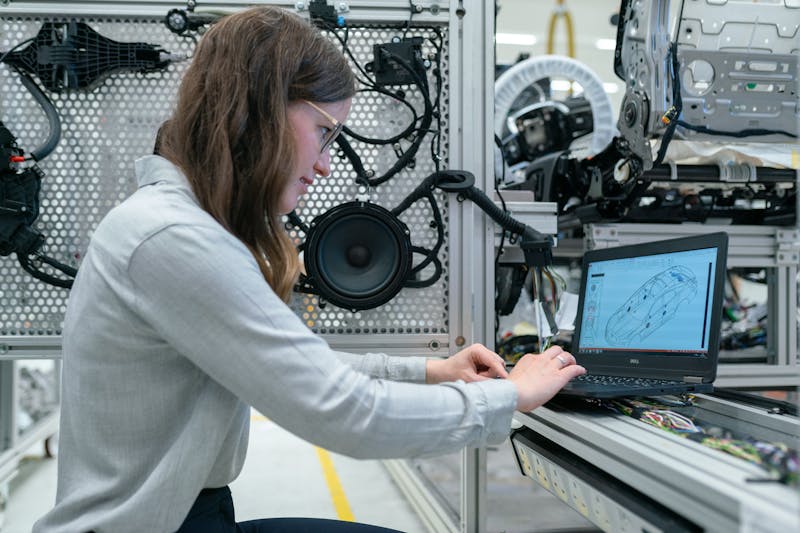

Den næste rolle er kvalitetssikring af output. Her producerer AI-systemet et resultat, som et menneske gennemgår, før det sendes videre. Et eksempel er en AI Agent, der udarbejder et kontraktudkast, som en jurist godkender, før det sendes til kunden. Systemet håndterer det tunge arbejde, mens mennesket sikrer nuance og korrekthed.

En tredje variant er feedback-loopet: mennesket giver løbende feedback på AI-systemets output, og denne feedback bruges til at forbedre modellen. Det er kernen i RLHF (Reinforcement Learning from Human Feedback), som er den metode, der har gjort store sprogmodeller (LLM'er) som ChatGPT og Claude brugbare i praksis.

Der er også en vigtig skelnen mellem Human-in-the-Loop og Human-on-the-Loop. I førstnævnte skal mennesket aktivt godkende hvert output. I sidstnævnte overvåger mennesket systemet løbende og griber kun ind, når noget afviger fra det forventede. Valget mellem de to afhænger af risikoniveauet og processens volumen.

Finanssektoren er et af de områder, hvor HITL er mest udbredt. AI-systemer kan flagge mistænkelige transaktioner for hvidvask eller svindel, men den endelige vurdering og indberetning foretages af en compliance-medarbejder. Systemet reducerer mængden af falske positiver, mens mennesket sikrer, at der ikke overses komplekse mønstre, som modellen ikke er trænet til at fange.

Inden for sundhed bruges HITL til diagnostisk støtte. AI kan analysere røntgenbilleder eller patologiprøver og foreslå diagnoser, men en læge tager den endelige beslutning. Her er HITL ikke blot et kvalitetstjek, det er et juridisk og etisk krav.

I marketing og salg er HITL særligt relevant i forbindelse med generativ AI. AI-systemer kan producere udkast til kampagnetekster, produktbeskrivelser eller kundekommunikation, men en marketingansvarlig gennemgår og tilpasser indholdet, før det publiceres. Det sikrer brandkonsistens og reducerer risikoen for hallucinationer.

For virksomheder, der implementerer agentic AI, er HITL en central komponent i guardrails-arkitekturen. Agenter kan handle autonomt inden for definerede rammer, men eskalerer automatisk til et menneske, når de møder situationer uden for deres mandat.

HITL er ikke en garanti for fejlfri AI. Forskning viser, at mennesker, der arbejder tæt med AI-systemer, over tid kan udvikle automation bias: en tendens til at stole blindt på systemets output og undlade at foretage kritisk vurdering. Hvis HITL-processer ikke designes med bevidst modstand mod denne tendens, kan det menneske, der skal fungere som sikkerhedsnet, reelt blive en stempelmaskine.

HITL er heller ikke en midlertidig løsning, der forsvinder, når AI bliver bedre. For mange anvendelser, særligt dem der involverer juridiske, etiske eller sikkerhedsmæssige beslutninger, vil menneskelig involvering forblive en permanent del af arkitekturen. Ansvarlig AI forudsætter, at nogen kan stilles til ansvar for en beslutning, og det kræver et menneske i processen.

Endelig er HITL ikke gratis skalering. Hver gang et menneske skal ind i loopet, tilføjes tid og omkostninger. Virksomheder skal derfor designe deres HITL-processer med omhu: hvor i processen giver menneskelig involvering størst værdi, og hvor kan AI handle sikkert på egen hånd?

AI Governance: Den overordnede ramme for, hvordan en organisation styrer, overvåger og kontrollerer sine AI-systemer. HITL er et centralt element i governance-modellen.

Guardrails: Tekniske og processuelle begrænsninger, der definerer, hvad et AI-system må og ikke må. HITL er ofte en guardrail i sig selv.

Agentic AI: AI-systemer, der handler autonomt. Jo mere autonomi, desto vigtigere bliver HITL som sikkerhedsmekanisme.

Ansvarlig AI (Responsible AI): Principperne for etisk og ansvarlig brug af AI. HITL er et af de vigtigste virkemidler til at operationalisere ansvarlig AI.

AI Hallucinationer: Når AI-systemer producerer faktuelt forkerte svar. HITL er en af de primære metoder til at fange hallucinationer, før de når slutbrugeren.

EU AI Act: EU's regulering af AI, som eksplicit kræver menneskelig overvågning af højrisiko-AI-systemer.

Op mod 56 % af alle Google-søgninger ender i dag uden et eneste klik. For B2B-virksomheder, der har...

Forestil dig en fremtid, hvor dine kunder aldrig besøger din hjemmeside igen. Ikke fordi du har...

AI kan nu producere videoer af jeres CEO, der er umulige at skelne fra ægte optagelser. Spørgsmålet...