OpenAI har netop delt en detaljeret retrospektiv om Symphony, deres open source-agent-orkestrator,...

Chain of Thought er en prompt-teknik, der får AI til at ræsonnere trin for trin. Lær hvordan CoT forbedrer AI-output.

I sin simpleste form handler CoT om at tilføje 'Tænk trin for trin' eller 'Forklar din ræsonnering' til promptet. Det får modellen til at generere mellemregningerne, inden den når konklusionen.

Eksempel uden CoT: 'Hvad er billigst: 3 stk. til 45 kr. eller 5 stk. til 70 kr.?' Modellen giver muligvis et forkert svar, fordi den springer til konklusionen.

Eksempel med CoT: 'Hvad er billigst: 3 stk. til 45 kr. eller 5 stk. til 70 kr.? Tænk trin for trin.' Modellen beregner stykprisen for begge (15 kr. vs. 14 kr.) og giver det korrekte svar.

Den trin-for-trin ræsonnering giver modellen 'plads til at tænke', hvilket reducerer fejl markant på opgaver, der kræver logik, matematik eller kompleks analyse.

Zero-shot CoT: Du beder simpelthen modellen om at tænke trin for trin, uden at give eksempler. Overraskende effektivt for mange opgaver.

Few-shot CoT: Du giver modellen 2 til 3 eksempler, hvor du selv viser den ønskede ræsonneringsproces. Modellen kopierer derefter mønsteret.

Self-consistency: Du kører det samme CoT-prompt flere gange og vælger det svar, der optræder oftest. Det øger pålideligheden.

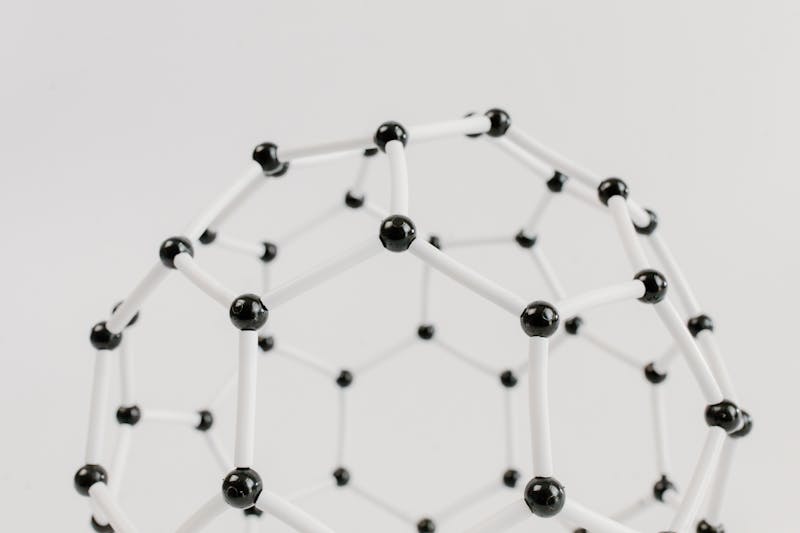

Tree of Thought: En avanceret variant, hvor modellen udforsker flere ræsonneringsstier parallelt og vælger den bedste. Brugt i nyere model-arkitekturer.

CoT er ikke en garanti for korrekte svar. Modellen kan stadig ræsonnere forkert. Men synlig ræsonnering gør det muligt for mennesker at opdage fejl i logikken, i stedet for at stå med et uforklarligt svar.

Det er heller ikke nødvendigt til alle opgaver. For simple spørgsmål med entydige svar kan CoT faktisk gøre output unødigt langt. Brug det til komplekse opgaver, der kræver logik, analyse eller flertrinsvurderinger.

Prompt Engineering: Den overordnede disciplin, CoT er en teknik inden for. LLM: Modellen, der bruger CoT til at ræsonnere. Few-shot Prompting: Teknikken til at give eksempler, der ofte kombineres med CoT. Zero-shot Learning: Teknikken, hvor modellen løser opgaver uden eksempler.