OpenAI har netop delt en detaljeret retrospektiv om Symphony, deres open source-agent-orkestrator,...

Fine-tuning tilpasser en AI-model til et specifikt domæne. Lær hvornår fine-tuning er det rigtige valg fremfor RAG.

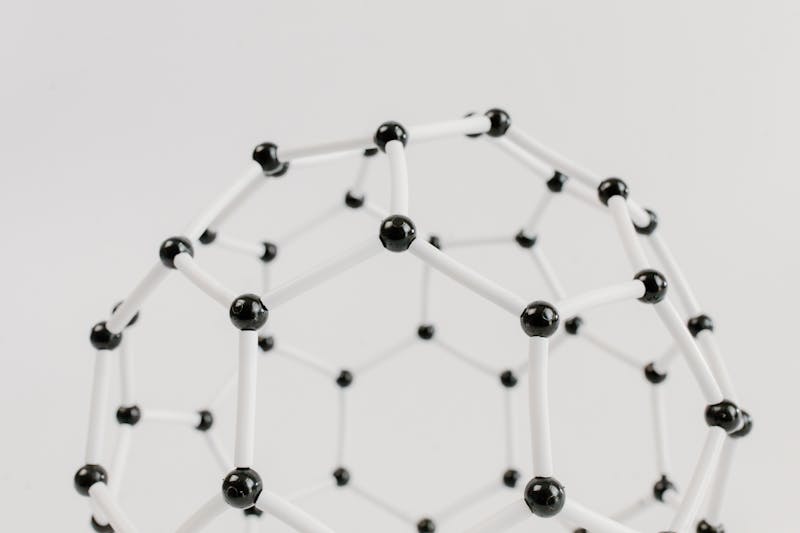

Fine-tuning starter med en pretrænet model, der allerede har lært generel sprogforståelse fra enorme datamængder. Modellen trænes derefter videre på et mindre, men målrettet datasæt, der repræsenterer det specifikke domæne.

Træningsdatasættet består typisk af input/output-par: for eksempel kundehenvendelser parret med ideelle svar i virksomhedens tone, eller medicinske journalnoter parret med korrekte diagnosekoder.

Modellens parametre justeres, så den prioriterer mønstre fra det nye datasæt. Resultatet er en model, der bevarer sin generelle sprogforståelse, men nu er specifikt god til den pågældende opgave.

Det er et af de mest stillede spørgsmål i enterprise AI, og svaret afhænger af opgaven:

Vælg RAG, når svaret afhænger af fakta, der ændrer sig over tid (priser, politikker, dokumentation). RAG henter information dynamisk og kræver ikke ny træning.

Vælg fine-tuning, når du vil ændre modellens adfærd, stil eller domæneviden permanent. For eksempel: en kundeservicemodel, der skal skrive i virksomhedens tone, eller en model, der skal forstå branchespecifik terminologi.

Kombinér begge, når du har brug for både domænespecifik adfærd og dynamisk adgang til opdaterede data. En fine-tuned model med RAG giver ofte det bedste resultat for komplekse enterprise use cases.

Fine-tuning er ikke det samme som prompt engineering. Prompt engineering ændrer instruktionen til modellen. Fine-tuning ændrer selve modellen.

Fine-tuning er heller ikke en garanti for bedre resultater. Hvis datasættet er for lille, af dårlig kvalitet eller ikke repræsentativt, kan fine-tuning faktisk forringe modellens generelle evner. Datakvalitet er den vigtigste succesfaktor.

RAG (Retrieval-Augmented Generation): Alternativet til fine-tuning for dynamisk viden. LLM (Large Language Model): Modellen, der fine-tunes. Foundation Model: Den pretrenede model, fine-tuning starter med. Synthetic Data: Kunstigt genererede træningsdata, ofte brugt til fine-tuning. Prompt Engineering: Den lettere tilgang til at styre modellens adfærd uden træning.