ChatGPT Images 2.0: OpenAIs nye billedmodel med thinking-mode

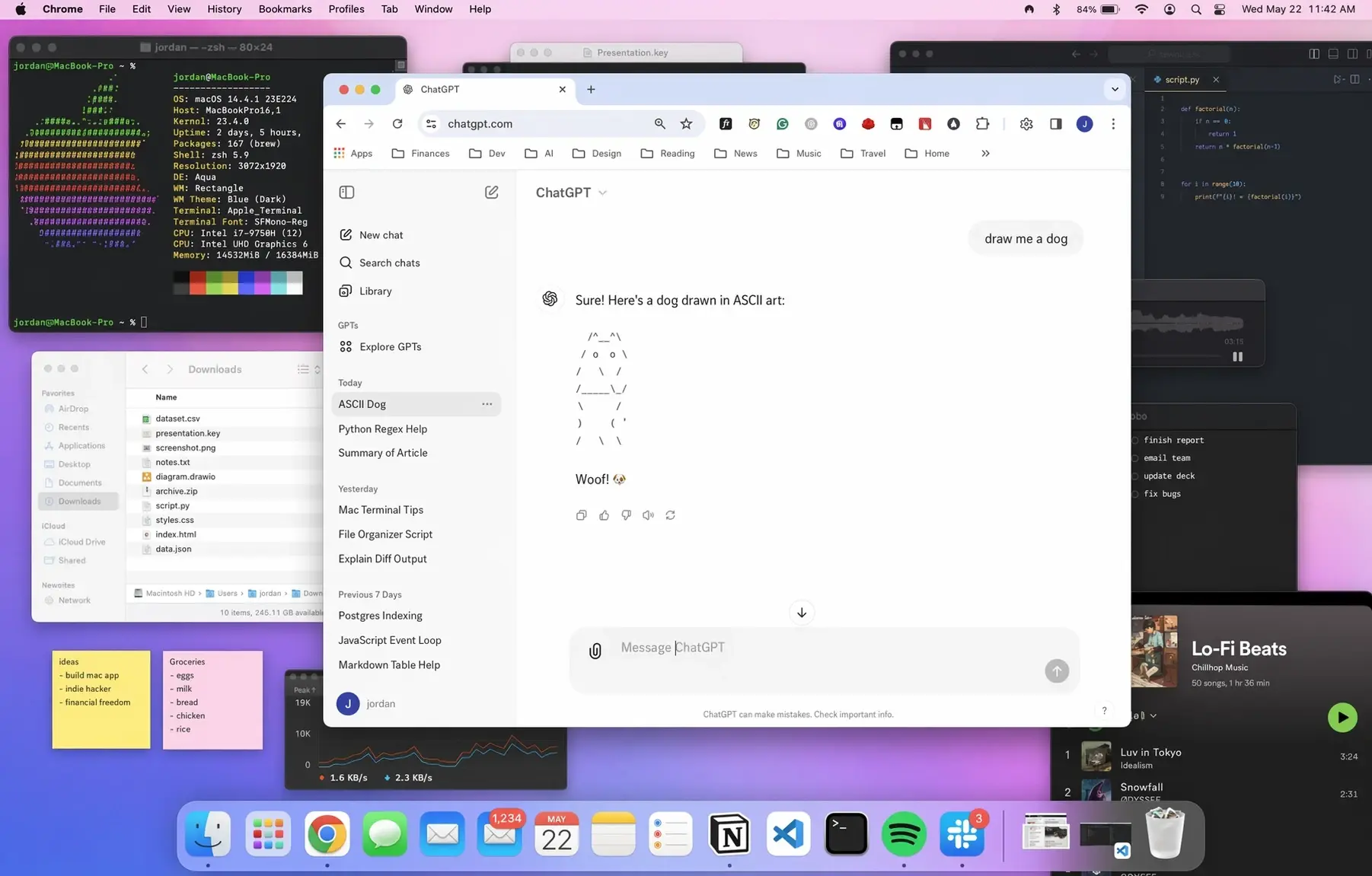

Den 21. april lancerede OpenAI ChatGPT Images 2.0, og det er ikke bare endnu en iteration af deres billedmodel. Det er den første visuelle model fra OpenAI, der kan ræsonnere, søge på nettet og levere sammenhængende billeder i serier. Model…

Den 21. april lancerede OpenAI ChatGPT Images 2.0, og det er ikke bare endnu en iteration af deres billedmodel. Det er den første visuelle model fra OpenAI, der kan ræsonnere, søge på nettet og levere sammenhængende billeder i serier.

Modellen, som i API'en hedder gpt-image-2, markerer et skifte fra "billedgenerator" til "visual workflow platform". For danske B2B-virksomheder, der allerede bruger AI til content og design, betyder det færre omveje og mere produktionsklar output. Her er, hvad du skal vide.

Hvad er ChatGPT Images 2.0?

ChatGPT Images 2.0 er en foundation model til billedgenerering, tilgængelig i ChatGPT, Codex og via API under modelnavnet gpt-image-2. Den erstatter DALL-E 3 som OpenAIs flagship billedmodel og bringer samtidig en række nye funktioner, der rykker sektoren markant fremad. OpenAIs egen lanceringspost beskriver det som "a new era of image generation".

Det mest opsigtsvækkende er, at det er OpenAIs første billedmodel med thinking capabilities. Hvor tidligere billedmodeller genererede et billede i ét skud, kan gpt-image-2 bruge test-time compute til at analysere opgaven, søge information på nettet og double-checke sit eget output, før den færdige grafik returneres. Det flytter billedgenerering tættere på en reasoning model end en ren transformation.

Modellen er tilgængelig for alle ChatGPT- og Codex-brugere fra lanceringsdagen, mens de mest avancerede thinking-funktioner er forbeholdt Plus, Pro og Business. API'en er åbnet samtidigt, med priser, der varierer efter kvalitet og opløsning.

Kan du heller ikke følge med i AI-modellerne?

Der lander nye AI-modeller hver uge. Tilmeld dig nyhedsbrevet og få et kurateret overblik, så du kan fokusere på det, der flytter din forretning.

Hvad koster gpt-image-2 via API?

OpenAI har ikke offentliggjort en fast pris pr. billede, men oplyser, at prisen afhænger af både kvalitet og opløsning. Forvent højere omkostninger pr. kald sammenlignet med DALL-E 3, særligt når thinking-mode aktiveres, da modellen bruger ekstra compute til planlægning og verifikation.

Kan gpt-image-2 erstatte en grafiker til mit B2B-indhold?

Til simple opgaver som sociale medier-grafik, blog-thumbnails og UI-mockups er modellen tilstrækkelig i mange tilfælde. Til brand-kritisk materiale, trykklare filer og komplekse layouts med tætte teksturer er der stadig brug for menneskelig kvalitetskontrol. OpenAI anerkender selv, at detaljerede diagrammer og præcis fysisk reasoning stadig er svagheder.

Hvad er forskellen på Images 2.0 og Google Nano Banana 2?

Nano Banana 2 fra februar 2026 introducerede også tekst-i-billede som kernefunktion. ChatGPT Images 2.0 adskiller sig primært ved thinking-mode, op til 8 sammenhængende billeder pr. prompt og indbygget websøgning. Valget afhænger af jeres eksisterende stack. Kører I på Google Cloud, giver Nano Banana 2 mindst friktion. Bruger I allerede OpenAI til andet AI-arbejde, er gpt-image-2 det oplagte valg.

Thinking-mode og 8 sammenhængende billeder

Thinking-mode er den største arkitektoniske ændring i Images 2.0. Når den aktiveres, kan modellen bruge tid på at analysere prompten, lave webopslag og generere flere versioner parallelt, før det endelige output præsenteres. Det trækker tråde til samme chain of thought-princip, som reasoning-modeller som o3 og GPT-5.4 Thinking benytter.

En konkret konsekvens er, at modellen kan producere op til otte billeder fra ét prompt med visuel kontinuitet på tværs af dem. Det løser et klassisk problem i AI-billedgenerering: at få den samme karakter, stil eller produkt til at se ens ud på tværs af scener. Hvor du tidligere brugte timer på prompt-engineering og manuel sortering, kan gpt-image-2 nu levere et character sheet eller en komplet serie i ét kald.

For virksomheder, der arbejder med storytelling, produktvisualiseringer, manga eller tegneseriestil, er denne konsistens potentielt den største produktivitetsgevinst ved hele lanceringen.

Multilingual tekst og 2K opløsning

Tekst i billeder har historisk været en af de største svagheder ved AI-billedmodeller. Småt sat ord blev til gibberish, og ikke-latinske skrifttegn var stort set umulige at rendere. ChatGPT Images 2.0 håndterer nu detaljeret tekst, UI-elementer, ikonografi og tætte layouts op til 2K opløsning i ChatGPT og 4K via Microsoft Foundry-integrationen.

Multilingual-understøttelsen er også markant udvidet. Modellen renderer nu japansk, koreansk, kinesisk, hindi og bengali præcist i billeder. Det er ikke direkte relevant for dansk marketing, men for virksomheder, der arbejder med eksportmarkeder i Asien, fjerner det en bottleneck, der tidligere kostede eksterne designer-timer.

Mest interessant er nok, at modellen kan producere realistiske screenshots og UI-mockups med ægte, fungerende tekst. Det betyder, at infografikker, produktfeatures-illustrationer og onboarding-materiale til CRM-implementeringer kan bygges direkte i AI-værktøjet uden efterfølgende redigering i Photoshop.

Real-world intelligence og knowledge cutoff

Images 2.0 har en knowledge cutoff i december 2025, hvilket betyder, at modellen kender aktuelle produktnavne, logoer, typografiske trends og visuelle referencer fra dette tidsrum. Det er en markant forskel fra tidligere billedmodeller, der typisk havde en visuel forståelse baseret på ældre træningsdata.

Dertil kommer, at modellen selv kan integrere websøgning direkte i sit workflow. Når du beder om et billede, der involverer aktuelle fakta, for eksempel et kort over seneste EU-regulering eller en sammenligning mellem konkurrenter, søger modellen først på nettet og bygger informationen ind i billedet. Det mindsker fejl og behovet for at kopiere data manuelt.

For B2B-virksomheder, der producerer rapporter, whitepapers og investor-materialer, er dette formentlig den mest underkendte funktion i hele lanceringen. Det gør AI-billedgenerering til en del af en research-pipeline, ikke en adskilt kreativ aktivitet.

Hvad betyder det for dansk B2B?

For danske B2B-virksomheder er hovedpointen, at tærsklen for at integrere AI-genererede billeder i daglig produktion er faldet mærkbart. Hvor DALL-E 3 krævede efterbearbejdning for de fleste professionelle anvendelser, er gpt-image-2 tæt nok på produktionsklar til at kunne bruges direkte i mange workflows.

Der er dog fortsat svagheder at være opmærksom på. Ekstremt detaljerede diagrammer, præcis fysisk reasoning (for eksempel korrekt perspektiv i tekniske tegninger) og meget tætte teksturer kan kræve manuel kvalitetskontrol. Modellen kan også fortsat generere subtile fejl, særligt i finmekanik og UI-detaljer. Human-in-the-loop-review er stadig best practice, særligt til kundevendt content.

Vores anbefaling: brug en uge på at evaluere gpt-image-2 mod jeres eksisterende billedworkflow. Kør to eller tre konkrete opgaver gennem modellen, og sammenlign output og tidsforbrug med jeres nuværende proces. I de fleste tilfælde vil regnestykket give mening, men nogle opgaver er stadig bedre tjent med specialiseret software.

Kan du heller ikke følge med nyhedsstrømmen?

Det kan vi godt forstå, for hver uge bringer +20 nyheder! Du kan gøre som 1200+ andre profesionelle og modtage nyhederne direkte i din indbakke.

Blot udfyld formularen og du er med på holdet

Fortsæt læsningen

RTX Spark: AI-agenten flytter ned på din PC

Den 1. juni stillede Jensen Huang sig op på en scene i Taipei og sagde, at det er på tide at genopfinde PC'en. Den slags udmeldinger har vi …

OpenAI's skatteagent I dansk kontekst

OpenAI og Thrive Holdings har offentliggjort en case, hvor en Codex-drevet skatteagent landede 97 % nøjagtighed på 7.000 selvangivelser ford…

Dynamic workflows er kommet til Claude Code

Anthropic lancerede dynamic workflows i Claude Code den 28. maj, samtidig med Opus 4.8. Kort fortalt: Claude kan nu skrive et script, der sæ…