OpenAI har netop delt en detaljeret retrospektiv om Symphony, deres open source-agent-orkestrator,...

Algoritmisk bias opstår, når AI-systemer systematisk favoriserer bestemte grupper. Forstå årsagerne, konsekvenserne og hvordan din virksomhed undgår det.

Algoritmisk bias har tre primære kilder: skæve træningsdata, problematisk algoritmedesign og manglende diversitet i udviklingsprocessen. I praksis er træningsdata den hyppigste årsag. En AI-model lærer mønstre fra historiske data, og hvis disse data afspejler eksisterende fordomme eller underrepræsenterer bestemte grupper, arver modellen disse skævheder.

Et velkendt eksempel er Amazons rekrutteringsalgoritme, der blev trænet på ti års ansøgningsdata fra en mandsdomineret branche. Systemet lærte at nedprioritere kvindelige kandidater, ikke fordi det var programmeret til det, men fordi de historiske data signalerede, at mænd blev foretrukket. Amazon måtte skrotte systemet helt.

Bias kan også opstå i selve algoritmedesignet. Når udviklere vælger, hvilke variable der indgår i en model, og hvordan de vægtes, kan tilsyneladende neutrale faktorer fungere som proxyer for beskyttede karakteristika. Et postnummer kan eksempelvis korrelere med etnicitet, og en kreditmodel, der bruger postnummer som variabel, kan dermed diskriminere uden at kende ansøgerens baggrund.

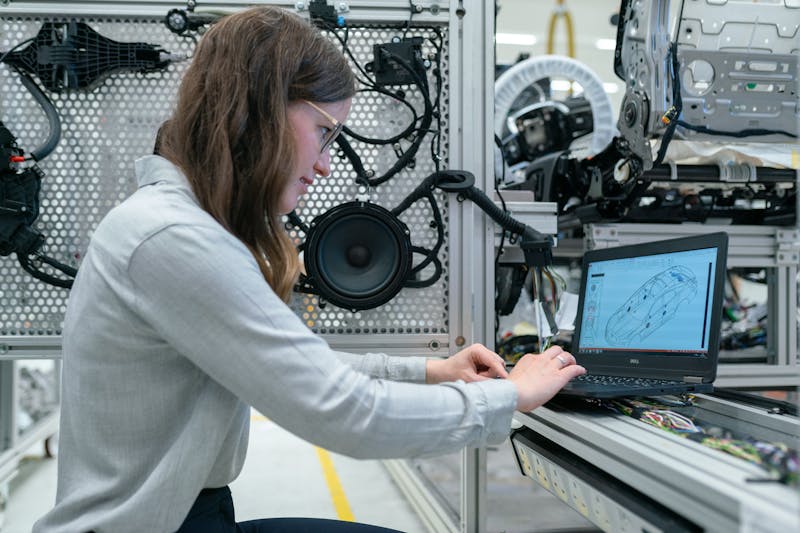

Endelig spiller teamets sammensætning en rolle. Uden diversitet i de teams, der bygger og tester AI-systemer, kan subtile bias passere igennem, fordi ingen i rummet oplever verden fra det perspektiv, der bliver forfordelt. Det er en af grundene til, at AI Governance kræver tværfaglige teams.

Konsekvenserne af algoritmisk bias rammer virksomheder på tre fronter: juridisk, økonomisk og omdømmemæssigt. Under EU AI Act klassificeres AI-systemer til rekruttering, kreditvurdering og retshåndhævelse som højrisiko, og manglende håndtering af bias kan udløse bøder på op til 35 millioner euro eller 7% af den globale omsætning.

Rekruttering er det mest eksponerede område. Undersøgelser viser, at AI-baserede CV-screeningsværktøjer favoriserer navne associeret med hvide kandidater i 85% af tilfældene. I Danmark har jobcentre oplevet, at forældede datasæt fik AI-systemer til at foreslå veluddannede ikke-etniske danskere job som pizzabud eller taxachauffør. Den slags fejl undergraver ikke bare retfærdigheden, men også virksomhedens evne til at tiltrække de bedste talenter.

I finanssektoren kan biased kreditmodeller systematisk tilbyde dårligere vilkår til bestemte befolkningsgrupper, selv når deres økonomiske profiler er sammenlignelige. Det fører til tab af kunder, regulatorisk opmærksomhed og risiko for kollektive søgsmål.

Marketing og kundeservice er også sårbare. Algoritmer, der personaliserer indhold eller prissætter produkter, kan utilsigtet diskriminere, hvis de trænes på data, der afspejler historiske forbrugsmønstre. Resultatet er, at virksomheden mister omsætning fra oversete segmenter og risikerer PR-kriser, når skævhederne opdages.

Den gode nyhed er, at virksomheder, der proaktivt håndterer bias, opbygger stærkere kundetillid og bedre beslutningsgrundlag. Fairness bør behandles som en målbar produktegenskab med klare KPI'er, ikke som et vagt ideal.

Algoritmisk bias er ikke det samme som, at en AI-model tager fejl. Alle modeller laver fejl, men bias handler specifikt om systematiske og gentagelige skævheder, der rammer bestemte grupper uforholdsmæssigt hårdt. En model kan have høj generel præcision og stadig være dybt biased, hvis den performer markant dårligere for specifikke demografier.

Det er heller ikke korrekt at antage, at bias forsvinder, hvis man fjerner beskyttede variable som køn eller etnicitet fra datasættet. Proxyer som postnummer, uddannelsesinstitution eller indkøbsmønstre kan korrelere med beskyttede karakteristika og dermed videreføre diskrimination. At adressere bias kræver mere end dataforberedelse; det kræver løbende monitorering, ansvarlig AI-principper og systematiske audits.

Endelig er algoritmisk bias ikke udelukkende et teknisk problem, der kan løses af datateams alene. Det er et organisatorisk og ledelsesmæssigt spørgsmål, der kræver klare politikker, guardrails og involvering af forretningen i at definere, hvad fairness betyder i den konkrete kontekst.

AI Governance: Rammeværket for styring, kontrol og overvågning af AI-systemer i en organisation, herunder håndtering af bias.

Ansvarlig AI (Responsible AI): Den bredere disciplin, der sikrer, at AI-systemer udvikles og bruges etisk, retfærdigt og transparent.

EU AI Act: EU's regulering af kunstig intelligens, der stiller specifikke krav til håndtering af bias i højrisiko-systemer.

Guardrails: Tekniske og organisatoriske sikkerhedsforanstaltninger, der forhindrer AI-systemer i at producere skadelige eller biased output.

Explainable AI (XAI): Metoder til at gøre AI-beslutninger gennemsigtige, hvilket er afgørende for at identificere og rette bias.

Human-in-the-Loop (HITL): En tilgang, hvor mennesker indgår i AI-beslutningsprocessen og kan gribe ind, når bias opdages.

Data Privacy i AI: Beskyttelse af personlige data i AI-systemer, som er tæt forbundet med fair behandling og anti-diskrimination.