Metas forretnings-AI faciliterer nu over 10 millioner samtaler om ugen via WhatsApp og Messenger....

Multimodal AI kombinerer tekst, billeder, lyd og video i samme model. Forstå hvad det betyder for din virksomhed, og hvordan det adskiller sig fra traditionel AI.

En multimodal AI-model har separate encodere for hver datatype: en til tekst, en til billeder, en til lyd. Disse encodere omdanner input til numeriske repræsentationer (embeddings), der placeres i et fælles vektorrum. Modellen lærer at forbinde koncepter på tværs af modaliteter, så den forstår, at ordet "hund" og billedet af en hund hører sammen.

CLIP var banebrydende, fordi den blev trænet på 400 millioner billed-tekst-par fra internettet. I stedet for at lære fra manuelt annoterede datasæt lærte CLIP direkte fra naturligt sprog. Det betød, at modellen kunne genkende objekter og scenarier, den aldrig var specifikt trænet til, via såkaldt zero-shot classification.

Moderne multimodale modeller som GPT-4o og Gemini går videre. De kan ikke blot klassificere, men ræsonnere på tværs af modaliteter: analysere et diagram, læse teksten i det, krydsreferere med en tabel og give et samlet resumé. Det er et kvalitativt spring fra tidlige modeller som CLIP, der primært matchede billeder og tekst.

Teknisk set bruger de fleste systemer en fusionsmekanisme, der kombinerer features fra hver modalitet til en samlet repræsentation, før modellen genererer sit output. Kvaliteten af denne fusion afgør, hvor godt modellen forstår sammenhængen mellem f.eks. et billede og en tilhørende tekstbeskrivelse.

Multimodal AI åbner use cases, der var umulige med ren tekstbaseret AI. I kundeservice kan en chatbot nu modtage et foto af en beskadiget vare, analysere skaden visuelt og foreslå en løsning uden at kunden skal beskrive problemet i tekst. Det reducerer håndteringstiden markant og forbedrer kundeoplevelsen.

Inden for sundhed kombinerer multimodale systemer billedscanning, patientjournaler og laboratoriedata for at assistere med diagnostik. Et system kan analysere en røntgenbillede sammen med patientens symptombeskrivelse og foreslå mulige diagnoser, som lægen derefter validerer.

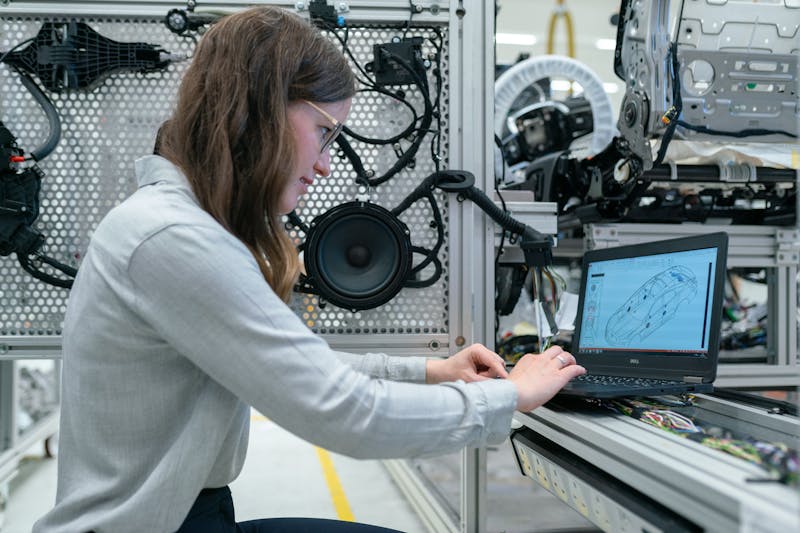

I produktionsvirksomheder bruges multimodal AI til kvalitetskontrol og predictive maintenance. Sensorer leverer numeriske data, kameraer leverer billeddata, og modellen samler begge dele for at identificere fejl, før de fører til nedetid. Ifølge Gartner pilottestede over 40 % af store virksomheder multimodale AI-systemer i 2025.

Inden for marketing og salg kan generativ AI med multimodale kapaciteter producere kampagner, der kombinerer tekst, billeder og video tilpasset specifikke målgrupper. Det gør hyper-personalisering praktisk mulig i stor skala.

Dokumentanalyse er et andet område med stor forretningsmæssig værdi. Multimodale modeller kan læse en PDF med tabeller, grafer og tekst og besvare spørgsmål, der kræver forståelse af alle elementerne samtidigt.

Multimodal AI er ikke det samme som at bruge flere separate AI-modeller i en pipeline. Forskellen er integration: en ægte multimodal model forstår sammenhængen mellem modaliteterne, mens en pipeline blot sender output fra en model til en anden uden dyb forståelse af forbindelsen.

Det er heller ikke en garanti for bedre resultater i alle scenarier. For rene tekstopgaver som oversættelse eller opsummering er en specialiseret sprogmodel ofte mere præcis og hurtigere. Multimodal AI tilføjer værdi, når opgaven faktisk kræver forståelse på tværs af datatyper. Risikoen for hallucinationer kan desuden være større i multimodale systemer, fordi fejl i én modalitet kan forstærkes i andre.

Endelig er multimodal AI ikke synonymt med AGI (Artificial General Intelligence). Selvom multimodale modeller er imponerende, arbejder de stadig inden for afgrænsede opgaver og har ikke generel forståelse eller bevidsthed.

LLM (Large Language Model): Den sprogmodel, der typisk udgør den tekstbaserede kerne i multimodale systemer. Embeddings: De numeriske repræsentationer, som multimodale modeller bruger til at placere forskellige datatyper i et fælles rum. Generativ AI: Det bredere felt, som multimodal AI er en del af, med fokus på at skabe nyt indhold. Deep Learning: Den underliggende teknologi bag de neurale netværk, der driver multimodale modeller. Foundation Model: De store forudtrænede modeller, som multimodale systemer bygger på. Vector Database: Den database-type, der lagrer embeddings og muliggør søgning på tværs af modaliteter. RAG (Retrieval-Augmented Generation): En arkitektur, der ofte kombineres med multimodal AI for at hente relevante data før generering. Context Window: Mængden af input, en model kan behandle på én gang, hvilket er særligt relevant for multimodale inputs.

Metas forretnings-AI faciliterer nu over 10 millioner samtaler om ugen via WhatsApp og Messenger....

Google Cloud har netop lanceret Gemini Enterprise Agent Platform og introduceret begrebet Agentic...

OpenAI har på under en uge lanceret to modeller, der ændrer balancen i AI-kapløbet. GPT-5.5 kom 23....