OpenAI har netop delt en detaljeret retrospektiv om Symphony, deres open source-agent-orkestrator,...

En vector database er hjørnestenen i RAG og semantisk søgning. Forstå hvordan den virker, og hvornår den giver værdi i jeres AI-arkitektur.

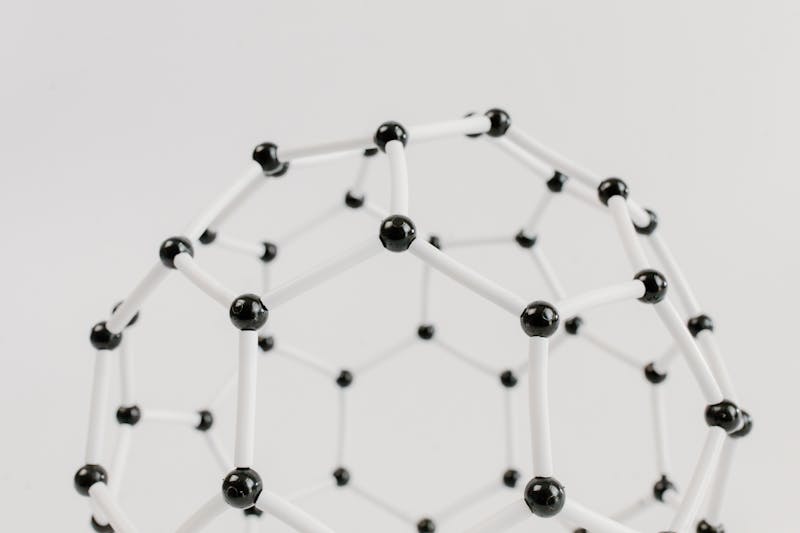

En vector database gemmer data som vektorer i et højdimensionelt rum. Typisk har hver vektor mellem 384 og 3072 dimensioner, afhængigt af den embeddings-model, der er brugt. En embeddings-model (fx fra OpenAI, Cohere eller en open source-model) konverterer indhold til tal, så betydningen er indkodet i vektorens placering i rummet. To dokumenter, der handler om det samme, ender tæt på hinanden i dette rum, selvom de bruger helt forskellige ord.

Når en bruger stiller et spørgsmål, konverteres spørgsmålet til den samme type vektor, og databasen finder de k nærmeste naboer ud fra en afstandsmåling (typisk cosinus-lighed). Det kaldes approximate nearest neighbor search, eller ANN, og er grunden til, at en vector database kan søge i milliarder af vektorer på millisekunder.

Under motorhjelmen bruger moderne vector databaser indekseringsalgoritmer som HNSW, IVF eller DiskANN for at accelerere søgningen. Disse strukturer lader systemet undgå at sammenligne forespørgslen med hver eneste vektor i databasen, og i stedet tage genveje gennem rummet uden at miste præcision af betydning.

Udover vektorerne selv gemmer de fleste enterprise vector databaser også metadata på hver post, fx forfatter, dato, kilde og adgangsrettigheder. Det er afgørende, fordi en søgning ofte skal kombineres med filtrering, før resultaterne sendes videre til modellen.

Vector databaser er i dag standardkomponenten i enterprise AI, og de bliver brugt til en håndfuld konkrete use cases, som de fleste virksomheder vil kunne genkende.

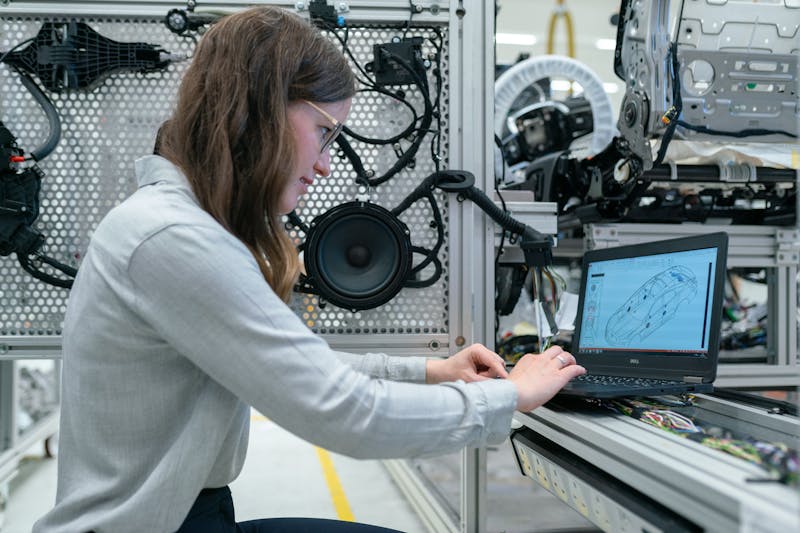

Intern vidensbase og RAG: Medarbejdere stiller spørgsmål til virksomhedens egen dokumentation, kontrakter, politikker og rapporter. Vector databasen finder de mest relevante passager, og en LLM genererer et præcist svar med kildehenvisninger. Det er den mest udbredte anvendelse og fundamentet for de fleste enterprise AI-projekter.

Semantisk kundesupport: I stedet for nøgleordssøgning i en FAQ forstår systemet, hvad kunden mener. Et spørgsmål om "min faktura er forsinket" finder artikler om betalingsproblemer, selvom ordet "forsinket" ikke optræder i dokumentationen. Det reducerer eskaleringer og forbedrer første-svar-rate.

Anbefalinger og personalisering: E-handel og medievirksomheder bruger vector databaser til at finde produkter, artikler eller brugere med lignende profiler i realtid, uanset om ligheden er baseret på billede, tekst eller adfærdsdata.

Dublet- og lighedssøgning: Virksomheder finder lignende billeder, kontrakter eller logs, fx til at opdage dobbeltarbejde i sagsbehandling eller til at matche CVer med jobopslag. Også semantisk søgning på tværs af store dokumentsamlinger bygger på samme princip.

En vector database er ikke en erstatning for en traditionel relationel database. Den er et supplement. Strukturerede data som ordrer, kundeoplysninger og finansielle transaktioner bliver stadig gemt bedst i SQL-baserede systemer. Vector databasen kommer ind, når du har brug for semantisk søgning i ustruktureret indhold.

Den er heller ikke det samme som en embeddings-model. Embeddings-modellen laver vektorerne; vector databasen gemmer og søger i dem. Mange virksomheder forveksler de to, og det fører til forkerte arkitekturvalg, hvor man investerer i den ene komponent uden at tænke på den anden.

Endelig er en vector database ikke en magisk løsning på dårlige hallucinationer. Hvis kildedataene er forældede, fejlbehæftede eller dårligt strukturerede, vil RAG-systemet stadig levere forkerte svar. Kvaliteten af det, der kommer ud af en vector database, er en direkte afspejling af det, der er lagt ind i den.

Embeddings: Numeriske repræsentationer, der indkoder betydningen af tekst, billeder eller lyd som vektorer.

RAG: Retrieval-Augmented Generation, hvor en LLM henter viden fra en vector database, før den svarer.

Semantic Search: Søgning efter betydning frem for nøgleord, bygget ovenpå embeddings og vector databaser.

LLM: Large Language Models, der bruger de hentede data til at generere svar.

Chunking: Opdeling af lange dokumenter i mindre bidder, før de konverteres til embeddings.

Knowledge Base: Den samling af dokumenter og data, der gøres søgbar gennem en vector database.

Retrieval Pipeline: Hele flowet fra forespørgsel til svar, som bygger på vector databasen som kerne.