Op mod 56 % af alle Google-søgninger ender i dag uden et eneste klik. For B2B-virksomheder, der har...

Knowledge distillation overfører viden fra store AI-modeller til mindre, hurtigere versioner. Forstå teknikken og dens værdi for virksomheder.

Processen starter med en stor, præcis model (læreren), der allerede er trænet på en opgave. Når læreren behandler et input, producerer den ikke bare ét svar, men en sandsynlighedsfordeling over alle mulige svar. Denne fordeling indeholder værdifuld information: Hvis læreren f.eks. klassificerer et billede som "kat" med 85 % sikkerhed, men også vurderer "los" til 10 % og "hund" til 3 %, afslører det, at katten ligner en los mere end en hund. Disse "bløde mål" (soft targets) er kernen i destillation.

Eleven trænes derefter til at efterligne lærerens sandsynlighedsfordelinger frem for blot de hårde etiketter (rigtigt/forkert). Det sker typisk via en kombineret tabsfunktion, der balancerer mellem at matche lærerens bløde output og de faktiske korrekte svar. En parameter kaldet "temperature" styrer, hvor bløde sandsynlighederne gøres under træning.

Resultatet er en model, der er markant mindre i parameterantal, men som har lært de underliggende mønstre og sammenhænge, læreren har opfanget. I praksis kan dette betyde en reduktion fra milliarder til millioner af parametre med kun et beskedent tab i præcision.

Der findes flere varianter af teknikken. Response-based distillation fokuserer på det endelige output. Feature-based distillation overfører viden fra modellens mellemliggende lag. Relation-based distillation bevarer forholdet mellem datapunkter på tværs af lag. Nyere tilgange som multi-teacher distillation lader eleven lære fra flere specialiserede lærere samtidig, hvilket kan give endnu bedre resultater.

Den mest umiddelbare forretningsværdi ved knowledge distillation er omkostningsreduktion. At køre en stor sprogmodel i produktion kan koste titusinder af kroner om måneden i cloud-compute. En destilleret version af samme model kan reducere denne omkostning med 80-90 % og samtidig svare inden for millisekunder i stedet for sekunder. For virksomheder med høje API-volumener er besparelsen betydelig.

Kundesupport og chatbots er et oplagt anvendelsesområde. En stor model kan trænes til at besvare komplekse kundehenvendelser med høj kvalitet, hvorefter dens viden destilleres til en kompakt model, der kører med under 100 ms latency. Det muliggør ægte realtidssamtaler uden den forsinkelse, brugerne oplever med store modeller.

Inden for finans bruger kreditvurderingssystemer og compliance-platforme destillerede modeller, fordi de skal træffe beslutninger hurtigt og ofte under regulatoriske krav om forklarbarhed. En mindre model er lettere at auditere og dokumentere, hvilket er afgørende under EU AI Act.

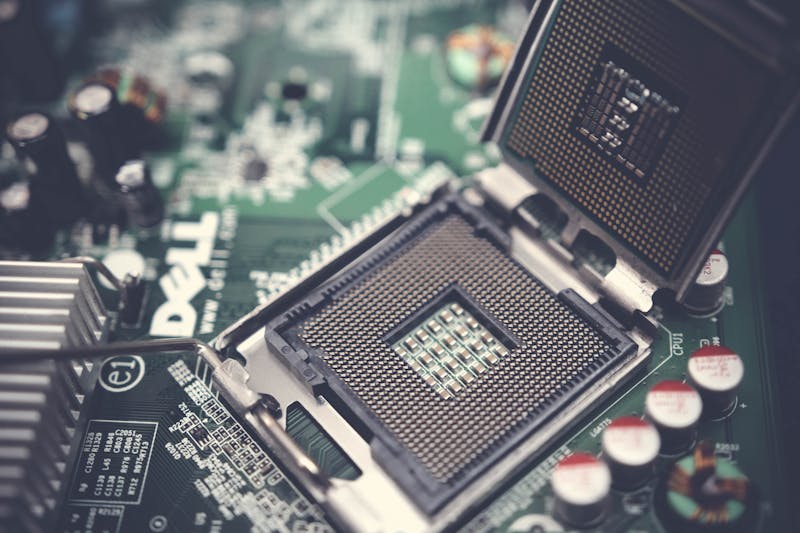

Edge-deployment er et tredje centralt scenarie. Producenter, der vil køre AI-modeller direkte på enheder (sensorer, mobiltelefoner, medicinsk udstyr) uden cloud-forbindelse, er afhængige af modeller, der er små nok til begrænset hardware. Knowledge distillation er den foretrukne metode til at skabe disse modeller uden at starte træningen fra bunden.

Endelig ser vi knowledge distillation som en kritisk komponent i AI-agent-arkitekturer, hvor hurtig inference er nødvendig for at agenter kan reagere i realtid og holde omkostningerne nede, selv ved tusinder af samtidige kald.

Knowledge distillation er ikke det samme som fine-tuning. Fine-tuning tilpasser en eksisterende models parametre til en specifik opgave, men modellen forbliver lige stor. Distillation skaber en helt ny, mindre model. De to teknikker kan dog kombineres: Man kan fine-tune en stor model til en opgave og derefter destillere den til produktion.

Destillation bør heller ikke forveksles med pruning (beskæring) eller kvantisering. Pruning fjerner dele af en eksisterende model, mens kvantisering reducerer præcisionen af modellens tal (f.eks. fra 32-bit til 8-bit). Distillation er fundamentalt anderledes, fordi den træner en helt ny model fra bunden, guidet af lærerens output. I praksis kombinerer mange virksomheder alle tre teknikker for maksimal effektivitet.

Det er også vigtigt at forstå, at destillation ikke er gratis kvalitet. Eleven kan arve lærerens fejl og bias. Hvis læreren hallucinerer eller er skæv i sin træningsdata, vil eleven sandsynligvis gøre det samme. Derfor kræver destillation grundig evaluering af både lærer og elev, og virksomheder bør teste den destillerede model grundigt, før den sættes i produktion.

LLM (Large Language Model): De store sprogmodeller, der ofte fungerer som "lærere" i knowledge distillation, og som destillation gør mere tilgængelige for produktion.

Fine-tuning: Tilpasning af en models parametre til en specifik opgave. Ofte brugt før destillation for at specialisere læreren.

Foundation Model: De brede basismodeller, som knowledge distillation typisk komprimerer til mere fokuserede og effektive versioner.

Deep Learning: Det overordnede felt af neurale netværk, som knowledge distillation opererer inden for.

Model Quantization (Modelkvantisering): En komplementær teknik, der reducerer modellens talpræcision for at spare hukommelse og øge hastighed.

Small Language Model (SLM): De kompakte modeller, der ofte er resultatet af en destillationsproces.

Inference: Selve processen, hvor en AI-model genererer output baseret på input. Destillation reducerer inference-omkostningen markant.

Op mod 56 % af alle Google-søgninger ender i dag uden et eneste klik. For B2B-virksomheder, der har...

Forestil dig en fremtid, hvor dine kunder aldrig besøger din hjemmeside igen. Ikke fordi du har...

AI kan nu producere videoer af jeres CEO, der er umulige at skelne fra ægte optagelser. Spørgsmålet...