OpenAI har netop delt en detaljeret retrospektiv om Symphony, deres open source-agent-orkestrator,...

AI Risk Management handler om at identificere, vurdere og håndtere risici ved AI-systemer. Lær frameworks, best practices og krav fra EU AI Act.

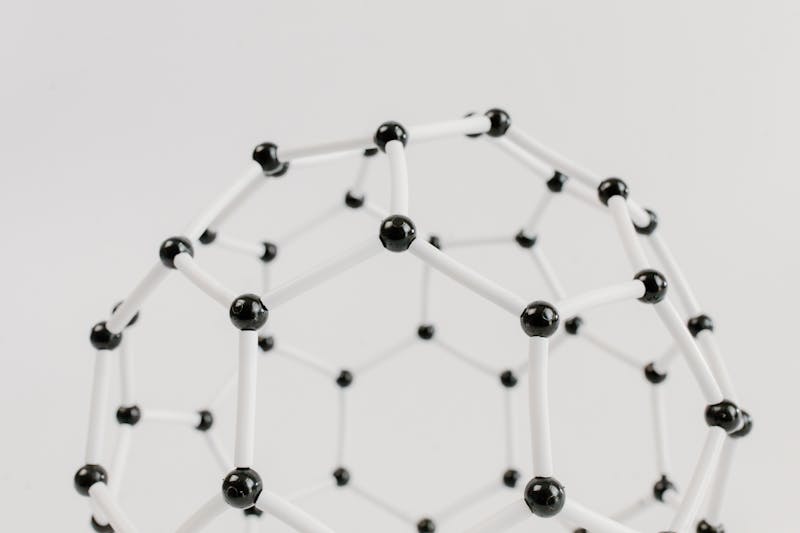

AI Risk Management bygger på en cyklisk proces, hvor risici identificeres, vurderes, håndteres og monitoreres løbende. Det mest udbredte framework er NIST AI Risk Management Framework (AI RMF), der strukturerer arbejdet i fire funktioner: Govern, Map, Measure og Manage.

Govern handler om at etablere en risikobevidst kultur med klare roller, politikker og ledelsesforankring. Det er fundamentet, der sikrer, at risikostyring ikke lever isoleret i en compliance-afdeling, men er integreret i hele organisationens AI-praksis.

Map fokuserer på at forstå konteksten for hvert AI-system: hvem påvirkes, hvilke data bruges, og hvilke konsekvenser kan opstå? Det kræver tværfagligt samarbejde mellem tekniske teams, forretningen og juridiske funktioner.

Measure og Manage dækker selve risikovurderingen og de konkrete tiltag. Her måles risici kvantitativt og kvalitativt, og der implementeres kontroller som guardrails, human-in-the-loop-processer, løbende monitorering og audit trails.

For virksomheder i EU suppleres NIST-frameworket med kravene i EU AI Act, der gør dele af risikostyringen juridisk bindende for højrisiko-AI-systemer.

Virksomheder, der implementerer AI i stor skala, møder risici på flere niveauer. Tekniske risici omfatter bias i træningsdata, der fører til diskriminerende output, model drift, hvor systemets præcision falder over tid, og sikkerhedshuller, der kan udnyttes til dataudtræk eller manipulation.

Operationelle risici handler om afhængighed af AI-systemer i kritiske processer. Når en AI-model styrer kreditvurderinger, kundesegmentering eller produktionsplanlægning, kan fejl have direkte forretningsmæssige konsekvenser. Derfor kræver produktions-AI det samme niveau af risikostyring som andre forretningskritiske systemer.

Regulatoriske risici er vokset markant med EU AI Act, der klassificerer AI-systemer i risikokategorier og stiller specifikke krav til dokumentation, transparens og governance. Virksomheder, der ikke har styr på deres AI-risikoprofil, risikerer bøder og indskrænkninger.

Den største forretningsmæssige gevinst ved struktureret AI Risk Management er ikke undgåelse af straf. Det er tillid. Kunder, bestyrelser og samarbejdspartnere har brug for at vide, at AI-beslutninger er gennemsigtige, kontrollerbare og pålidelige. Virksomheder med moden risikostyring kan skalere hurtigere, fordi de har de nødvendige kontroller på plads fra starten.

AI Risk Management er ikke det samme som at stoppe AI-projekter eller indføre bureaukrati, der kvæler innovation. Det er en udbredt misforståelse. En velfungerende risikostyringsproces gør det nemmere at træffe hurtige beslutninger, fordi rammerne allerede er defineret. Teams behøver ikke diskutere grundlæggende spørgsmål om ansvar og kontrol fra projekt til projekt.

Det er heller ikke en ren IT-disciplin. AI-risici spænder over teknik, jura, etik og forretning. En risikostyringsproces, der kun lever i IT-afdelingen, vil overse risici relateret til lovgivning, omdømme og forretningsstrategi. Effektiv AI Risk Management kræver tværfaglige teams med repræsentation fra ledelse, compliance, data science og de forretningsområder, der bruger AI.

Endelig er AI Risk Management ikke en engangsvurdering. AI-systemer ændrer sig over tid, data ændrer sig, og regulering ændrer sig. Risikostyring er en løbende proces med kontinuerlig monitorering, periodiske reviews og klare eskaleringsmekanismer, når nye risici opstår.

AI Governance: Den overordnede ramme af politikker, roller og processer, der styrer en organisations brug af AI. AI Risk Management er en central del af governance-strukturen.

EU AI Act: EU's regulering af AI, der klassificerer systemer i risikokategorier og stiller krav til risikostyring for højrisiko-systemer.

Ansvarlig AI (Responsible AI): Principperne for etisk og ansvarlig udvikling og brug af AI, herunder fairness, transparens og ansvarlighed.

Guardrails: Tekniske og organisatoriske begrænsninger, der sikrer, at AI-systemer opererer inden for definerede rammer.

Human-in-the-Loop (HITL): En tilgang, hvor mennesker inddrages i AI-beslutningsprocesser for at sikre kontrol og kvalitet.

AI Compliance: Efterlevelse af lovgivning og standarder, der regulerer brugen af AI i virksomheder.

AI Audit Trail: Dokumentation af AI-systemers beslutninger og handlinger, der muliggør efterfølgende gennemgang og kontrol.

Algoritmisk Bias: Systematiske skævheder i AI-modeller, der kan føre til uretfærdige eller diskriminerende output.