OpenAI har lanceret Workspace Agents i ChatGPT som afløser for Custom GPTs. Det er AI-agenter, der...

Catastrophic forgetting er AI-modellers tendens til at glemme tidligere viden, når de lærer nyt. Forstå problemet, dets konsekvenser og løsninger for virksomheder.

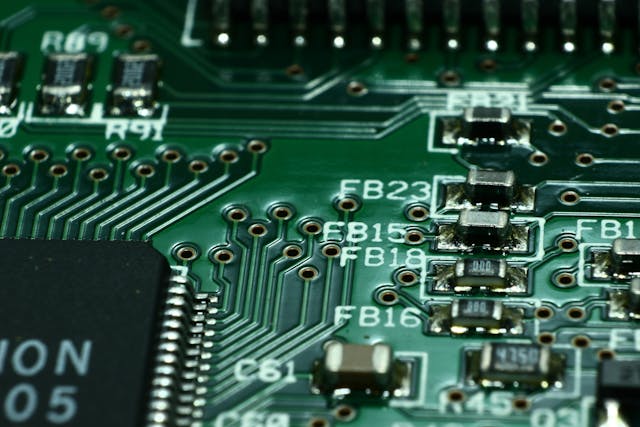

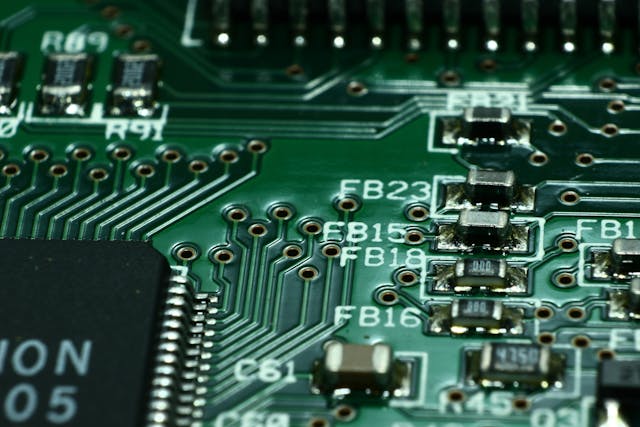

Et neuralt netværk lagrer sin viden i millioner (eller milliarder) af vægte. Når netværket trænes på en opgave, justeres disse vægte for at minimere fejl på netop den opgave. Problemet opstår, når netværket efterfølgende trænes på en ny opgave: de samme vægte justeres igen, og den justering kan ødelægge den præcise konfiguration, der repræsenterede den gamle viden.

Det svarer til at skrive i en notesbog med begrænset plads. Når de nye noter fylder, bliver de gamle overskrevet. I modsætning til menneskelig hukommelse, hvor ny læring typisk styrker eller supplerer eksisterende viden, erstatter netværkets opdateringer ofte den gamle viden direkte.

I praksis er problemet størst, når den nye træningsdata er markant anderledes end den oprindelige. Hvis en foundation model trænet på bred tekst finjusteres udelukkende på medicinske artikler, kan den miste evnen til at føre almindelig samtale eller forstå hverdagssprog.

Omfanget af glemsel afhænger af flere faktorer: hvor mange vægte der opdateres, hvor stor forskellen er mellem gammel og ny opgave, og hvor aggressivt modellen trænes. Små, forsigtige opdateringer giver mindre glemsel, men også langsommere læring af det nye.

For virksomheder, der bygger AI-løsninger, er catastrophic forgetting ikke et abstrakt forskningsproblem. Det er en praktisk udfordring, der påvirker økonomi, kvalitet og governance. Når en finjusteret model pludselig håndterer generelle forespørgsler dårligere, påvirker det brugeroplevelsen og tilliden til systemet.

Mange organisationer opdager problemet, når de vil tilpasse en generel sprogmodel til deres domæne. En kundeservicemodel, der finjusteres på interne FAQ-dokumenter, kan miste evnen til at håndtere forespørgsler, der falder uden for det nye træningssæt. Det tvinger virksomheder til at vedligeholde flere specialiserede modeller i stedet for én fleksibel model, hvilket øger infrastrukturomkostninger og kompleksitet.

Konsekvenserne rækker ud over teknisk performance. I regulerede brancher som finans og sundhed kan en model, der uventet mister kompetencer, skabe compliance-risici. Hvis en model til AI Risk Management pludselig glemmer regler, den tidligere fulgte, kan det have reelle forretningsmæssige konsekvenser.

Løsningen for de fleste virksomheder er proaktiv: inkluder et repræsentativt udsnit af generelle opgaver i fine-tuning-datasættet, test for regression på eksisterende kompetencer efter hver træningsrunde, og overvej teknikker som LoRA eller Elastic Weight Consolidation, der begrænser omfanget af vægtændringer.

Catastrophic forgetting er ikke det samme som model drift. Model drift sker, når en models performance gradvist falder, fordi de data, den møder i produktion, ændrer sig over tid. Catastrophic forgetting sker derimod under selve træningen og er ofte abrupt: modellen mister viden øjeblikkeligt, ikke gradvist.

Det er heller ikke et tegn på, at modellen er dårlig eller defekt. Catastrophic forgetting er en iboende egenskab ved den måde, neurale netværk lærer på. Det gælder alle netværkstyper, fra simple feed-forward-netværk til de mest avancerede deep learning-arkitekturer.

Endelig skal det ikke forveksles med underfitting, hvor en model aldrig har lært en opgave ordentligt. Ved catastrophic forgetting har modellen demonstreret mestring af opgaven, men mister den efterfølgende.

Fine-tuning: Processen med at tilpasse en forudtrænet model til en specifik opgave. Catastrophic forgetting er den primære risiko ved fine-tuning.

Continual Learning: Forskningsfeltet, der specifikt adresserer, hvordan modeller kan lære løbende uden at glemme. Elastic Weight Consolidation og replay buffers er centrale teknikker.

Knowledge Distillation: En teknik, hvor en stor models viden overføres til en mindre model. Self-distillation bruges som løsning på catastrophic forgetting.

Foundation Model: De store forudtrænede modeller, der typisk finjusteres til specifikke opgaver, og dermed udsættes for risikoen for catastrophic forgetting.

Model Drift: Den gradvise forringelse af en models performance over tid i produktion. Beslægtet med, men fundamentalt forskellig fra catastrophic forgetting.

LoRA: En parametereffektiv fine-tuning-metode, der kun opdaterer et lille antal vægte og dermed reducerer risikoen for catastrophic forgetting markant.

OpenAI har lanceret Workspace Agents i ChatGPT som afløser for Custom GPTs. Det er AI-agenter, der...

Den 20. april 2026 ændrede Anthropic stille og roligt hvad et AI-output kan være. Live Artifacts i...

Anthropic lancerede den 23. april 2026 hukommelse til Claude Managed Agents. Det fjerner et af de...