OpenAI lancerede mandag den 11. maj 2026 deres nye paraply for cyberforsvar: Daybreak. Det er ikke...

NVIDIA NIM er en suite af inference-microservices, der gør det nemt at deploye AI-modeller i produktion. Forstå hvad NIM er, og hvornår det giver mening.

NIM fungerer ved at pakke en AI-model sammen med NVIDIAs optimerede inference-software i en container. Containeren inkluderer TensorRT-LLM til modeloptimering og Triton Inference Server til high-throughput serving. Resultatet er en microservice, der eksponerer et standard API, som udviklere kan kalde direkte fra deres applikationer.

Når en virksomhed vil deploye fx Meta Llama eller en anden foundation model, downloader de blot den relevante NIM-container og starter den. Modellen er allerede optimeret til den specifikke GPU-hardware, og API'et følger OpenAI-standarden, så eksisterende kode kan genbruge forbindelsen uden ændringer.

NIM håndterer automatisk batching af forespørgsler, skalering på tværs af GPU'er og load balancing. Det betyder, at virksomheden ikke behøver specialiserede MLOps-ingeniører til at tune inference-performancen manuelt.

En væsentlig fordel er fleksibiliteten i deployment. NIM kan køre i public cloud, on-premise datacentre, på workstations og endda på edge-enheder. Data forlader aldrig virksomhedens infrastruktur, medmindre man vælger det.

NIM er designet til virksomheder, der har brug for at køre AI-modeller i produktion med lav latency og høj gennemstrømning. Det er særligt relevant i scenarier, hvor data ikke må forlade virksomhedens egen infrastruktur, eller hvor skalerbarhed er kritisk.

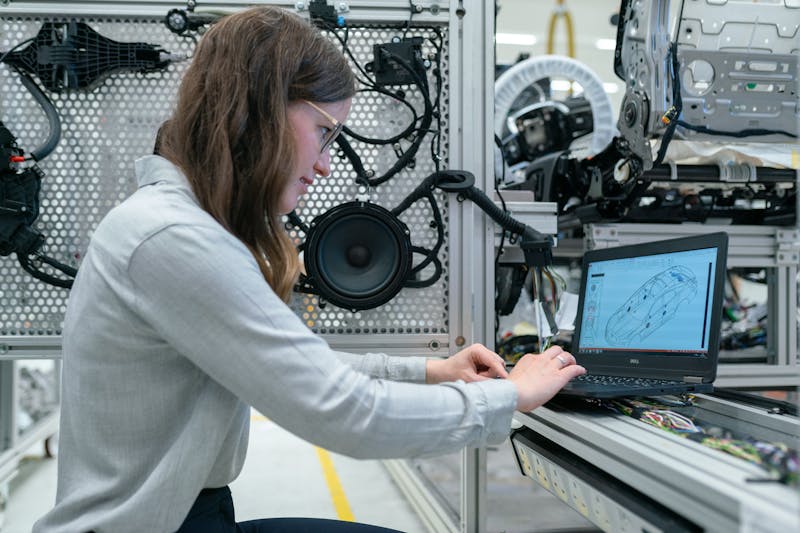

Inden for kundeservice bruger virksomheder NIM til at drive conversational AI-løsninger og digitale assistenter, der kan besvare forespørgsler i realtid. Siemens har fx integreret NIM i deres Industrial Copilot, som hjælper operatører på fabriksgulvet med at fejlfinde og optimere produktion.

I farmaceutisk forskning driver NIM BioNeMo-platformen, der accelererer drug discovery ved at generere proteinstrukturer. For produktionsvirksomheder som Foxconn understøtter NIM domænespecifikke sprogmodeller til smart manufacturing, kvalitetskontrol og logistikoptimering.

Benchmarks viser, at NIM kan levere op til 3x flere tokens per sekund sammenlignet med ikke-optimerede deployment-setups. Det oversættes direkte til lavere omkostninger per forespørgsel og muligheden for at betjene flere brugere med den samme hardware.

NIM Agent Blueprints udvider desuden NIM med færdige skabeloner til enterprise-workflows som RAG-baseret dokumentsøgning, digital human customer service og multimodal PDF-ekstraktion.

NIM er ikke en AI-model i sig selv. Det er infrastruktur-software, der gør det lettere at deploye og køre eksisterende modeller. Man skal stadig vælge, hvilken model man vil bruge, og NIM ændrer ikke modellens evner eller træningsdata.

NIM er heller ikke et alternativ til model-træning eller fine-tuning. Hvis virksomheden har brug for en model, der er tilpasset deres specifikke domæne, skal det ske separat. NIM tager sig af det næste trin: at få den trænede model ud i produktion effektivt.

Det er også vigtigt at forstå, at NIM er bundet til NVIDIA GPU-hardware. Virksomheder, der kører inference på CPU'er eller andre acceleratorer, kan ikke bruge NIM direkte. Det er en del af NVIDIAs samlede økosystem, ikke en hardwareagnostisk løsning.

Inference: Processen, hvor en trænet AI-model genererer output baseret på input. NIM optimerer netop dette trin. LLM (Large Language Model): De store sprogmodeller, som NIM typisk deployer, fx Llama, Mistral og GPT-varianter. Foundation Model: De basismodeller, som NIM pakker ind i optimerede containere til produktion. Edge AI: AI-inferens på lokale enheder, et af de deployment-scenarier NIM understøtter. Cloud AI: AI-workloads i skyen, hvor NIM også kan deployes. Model Deployment: Den overordnede disciplin, som NIM automatiserer og forenkler. On-premise AI: AI-drift på virksomhedens egne servere, et kernescenarie for NIM. Inference: Det specifikke trin i AI-pipelinen, som NIM accelererer.

OpenAI lancerede mandag den 11. maj 2026 deres nye paraply for cyberforsvar: Daybreak. Det er ikke...

IBM Think 2026 fandt sted den 5. maj i Boston, og konferencens budskab var klart: virksomheder, der...

Microsoft har 1. maj gjort Agent 365 generelt tilgængelig som control plane til AI-agenter, og...