Meta dropper open-source: Hvad Muse Spark betyder for jer

Meta lukkede i april 2026 døren til open source-æraen. Med lanceringen af Muse Spark den 8. april sender Meta-koncernen for første gang en frontier-model på markedet uden open weights, uden Apache-licens og uden Hugging Face-download. For d…

Meta lukkede i april 2026 døren til open source-æraen. Med lanceringen af Muse Spark den 8. april sender Meta-koncernen for første gang en frontier-model på markedet uden open weights, uden Apache-licens og uden Hugging Face-download.

For danske virksomheder, der har bygget RAG-pipelines, interne assistenter eller on-premise-løsninger oven på Llama, er det ikke bare en produktnyhed. Det er et signal om, at den økonomiske tyngdekraft har trukket selv den mest profilerede open source-spiller væk fra åbne vægte, og at jeres AI-stack skal genbesøges nu, ikke til efteråret.

Muse Spark på 60 sekunder: Hvad Meta rent faktisk har lanceret

Muse Spark er den første model fra Meta Superintelligence Labs (MSL), den enhed som Alexandr Wang har ledet siden Metas investering på cirka 14,3 milliarder dollar i Scale AI i sommeren 2025. Ifølge Metas egen annoncering er det en multimodal reasoning-model med sub-agent-orkestrering, som kan deploye flere specialiserede underagenter samtidig og håndtere visuelle STEM-opgaver og sundheds-use cases udviklet i samarbejde med omkring 1.000 læger.

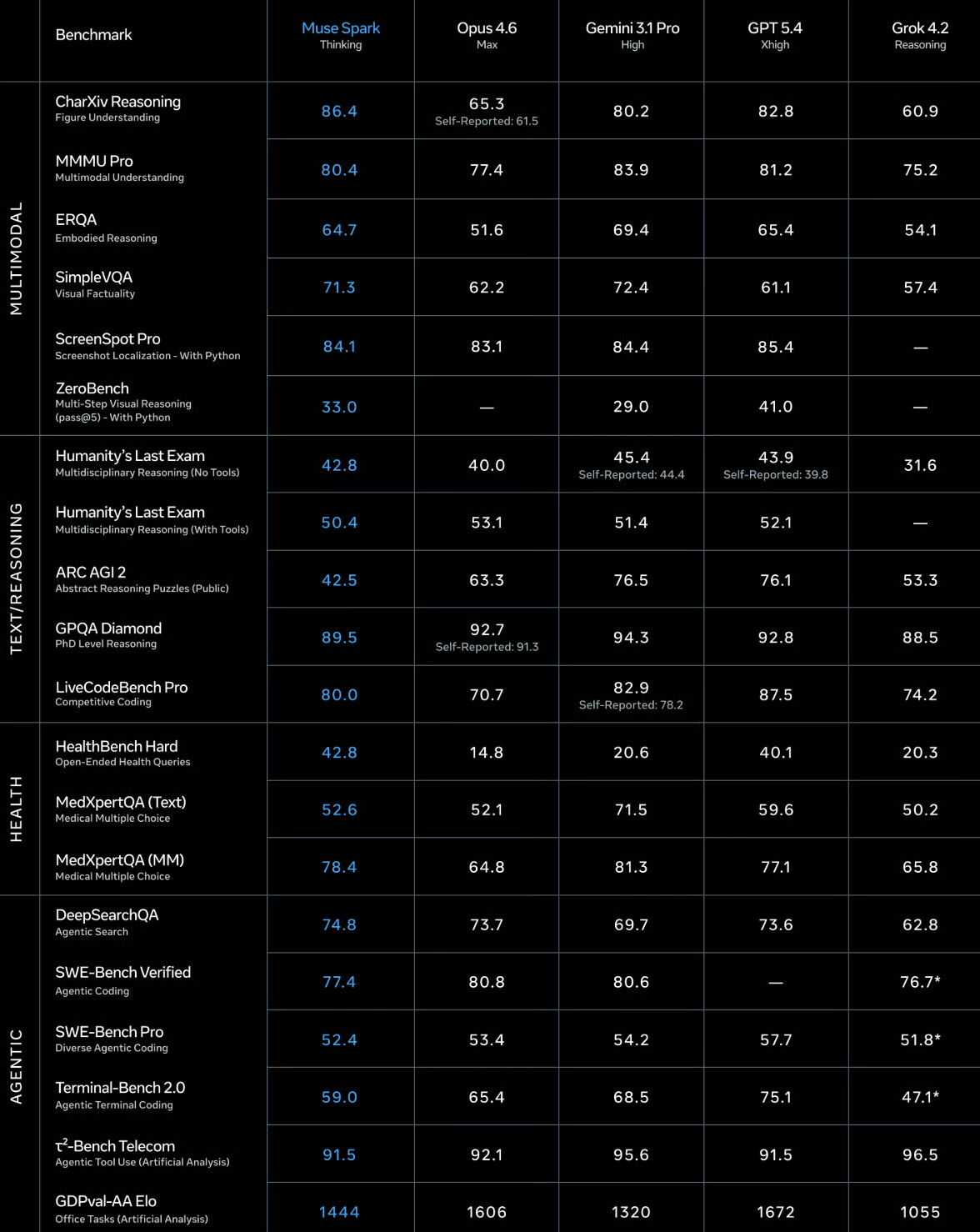

På papiret er kapabiliteterne ikke en stor overraskelse. Muse Spark matcher eller overgår ifølge Metas egne benchmarks de førende modeller fra OpenAI, Anthropic og Google, og modellen kører nu på Meta.ai og i Meta AI-appen med udrulning til Facebook, Instagram og WhatsApp, hvor den erstatter de hidtidige Llama-baserede assistenter. Det banebrydende ligger et andet sted.

For første gang i Metas moderne AI-historie er der ingen open weights. Ingen Apache-licens. Ingen Hugging Face-download. Muse Spark er et lukket, proprietært produkt, og flere internationale medier beskriver det som et radikalt brud med den Llama-strategi, der i to år har positioneret Meta som open source-alternativet til OpenAI, Anthropic og Google.

Skal I træffe store AI-beslutninger i 2026?

Få hver uge de vigtigste skift i foundation models, AI Act og enterprise-stacken leveret direkte i indbakken.

Betyder Muse Spark, at Llama 3 og 4 bliver ubrugelige?

Nej. Eksisterende Llama-modeller forsvinder ikke, og både Llama 3 og 4 fortsætter med at virke i jeres opsætninger. Men Meta har signaleret, at frontier-udviklingen flytter over i Muse Spark-familien, så I skal regne med, at Llama-grenen ikke får samme tempo i opdateringer fremover.

Hvad er det bedste open-source-alternativ til Llama lige nu?

Ifølge medierapporter fra april 2026 er Googles Gemma 4 under Apache 2.0-licens den stærkeste bredde-løsning for B2B-brug, og Mistral og DeepSeek er stadig relevante for specifikke use cases. Valget afhænger af jeres krav til modelstørrelse, sprog, context-vindue og hvor modellen skal køre.

Hvor hurtigt skal vi reagere på skiftet?

Der er ikke brug for panik, men der er brug for en plan. De fleste virksomheder bør bruge de næste to til tre måneder på at kortlægge deres Llama-afhængigheder, definere en vendor-diversification-politik og teste mindst ét alternativ i et pilotmiljø, så der er et reelt valg klar inden sommeren.

Llama-æraen er slut: Derfor skiftede Meta spor

For at forstå skiftet skal man tilbage til 2023 og 2024. Da lancerede Meta Llama 2 og senere Llama 3 med en licens, der i praksis lod enhver virksomhed under en vis størrelse tage modellen, fine-tune den og køre den on-premise. Det gav Meta en usædvanlig strategisk position: De var ikke afhængige af at slå OpenAI på kvalitet måned for måned, fordi de kunne sælge et alternativ, der ramte hele den europæiske sovereign cloud-dagsorden, regulerede brancher og prisfølsomme SMV’er.

Men frontier-modeller er blevet langt dyrere at træne. Når en enkelt generation kan koste milliardbeløb i compute, data og talent, bliver det svært at retfærdiggøre, at man giver slutproduktet væk gratis, mens konkurrenterne sælger det som API. Det pres er ikke unikt for Meta, men det er blevet meget synligt i deres regnskaber det seneste år. Samtidig har Alexandr Wangs ankomst gennem Scale AI-aftalen ifølge flere tekniske medier tippet den interne debat i retning af et mere produktorienteret og monetiseret setup.

Muse Spark er udspillet af den nye linje. Modellen er bygget til at blive distribueret gennem Metas egne flader og bør ses som rygraden i Meta AI-oplevelsen på Facebook, Instagram og WhatsApp fremfor som en komponent, man selv downloader. Zuckerberg vil stadig tale om åbenhed og forskning, men forretningslogikken er ny: Metas stærkeste model er nu en service, ikke en fil.

Det bliver interessant for europæiske B2B-beslutningstagere, fordi Llama-strategien har båret en stor del af de sidste to års argumentation for, hvorfor open source AI var et realistisk alternativ til de amerikanske API-udbydere. Det argument er ikke forsvundet, men det er svækket. Og det rejser spørgsmålet: Hvem bærer open source-fanen videre, når Meta tager den ned?

Konsekvenser for danske virksomheder, der byggede på Llama

Llama har været en favorit hos danske teams af én simpel grund: Den kunne køres lokalt. For en bank, et pharmaselskab eller en offentlig myndighed er forskellen mellem „sendes gennem en API i USA“ og „kører på vores egne GPU’er“ ofte forskellen mellem en PoC, der kan godkendes, og en PoC, der drukner i juridiske møder. Oven på Llama er der bygget RAG-pipelines, domænespecifikke fine-tunede modeller, interne chat-assistenter og agenter, der udfører processer i CRM- og ERP-systemer.

Den eksisterende brug forsvinder ikke fra den ene dag til den anden. Llama 3 og 4 fungerer fortsat, vægtene er allerede ude, og ingen kan trylle dem væk. På kort sigt er det reelle problem derfor ikke nedlukning, men stagnation. Når Metas frontier-udvikling flytter ind i Muse Spark-familien, vil Llama-grenen med stor sandsynlighed modtage færre, mindre og langsommere opdateringer. Jeres foundation model bliver ikke dårligere, men markedet omkring den bliver bedre.

På mellemlang sigt er det mere strategisk. Et system, der er bygget omkring en bestemt model, bærer skjulte afhængigheder i form af promptmønstre, tokenizer-antagelser, fine-tuning-datasæt og evalueringsharnesses. Hvis I om 12 eller 18 måneder er nødt til at udskifte LLM-grundlaget, er det ikke en „swap en linje i config“-øvelse. Det er en migration, og den koster mest, når den sker akut frem for planlagt.

Endelig er der governance-laget. Under EU AI Act er det en fordel at kunne dokumentere, hvilken model man bruger, hvordan den er trænet, og hvor data flyder. Åbne modeller gør den del lettere, fordi I har adgang til flere detaljer om træning og licensbetingelser. Jo mere lukket stakken bliver, jo mere arbejde skal I lægge i auditerbare logs, model cards og kontraktuelle garantier fra leverandøren. Det er ikke en showstopper, men det er en kollegial påmindelse om, at „det er billigere at holde på Llama“ ikke altid holder stik, når compliance-omkostningerne regnes med.

Der er også en tredje, ofte overset dimension: talent og kompetencer. Når en bred udviklerbase har brugt to år på at lære Llamas tokenizer, promptmønstre og fine-tuning-opskrifter, repræsenterer det en betydelig intern investering. Den viden forsvinder ikke, men den skal gradvist suppleres med erfaring fra andre modelfamilier, hvis I vil undgå at blive fanget i en mono-kultur. Planlæg derfor bevidst, at jeres team får lov til at bygge mindre POC’er på Gemma 4, Mistral eller en tredje kandidat i andet kvartal 2026, så kompetencespredningen følger med leverandørspredningen.

Hvem arver open source-tronen? Gemma 4, Mistral, DeepSeek og Qwen

Den mest bemærkelsesværdige modvægt kommer fra Google. Kun seks dage før Muse Spark lancerede Google Gemma 4 under en Apache 2.0-licens, og ifølge Googles egen annoncering kommer familien i fire størrelser fra kompakt til stor, med et udvidet context-vindue og sovereign cloud-understøttelse gennem Google Cloud. Uanset hvad man synes om Google generelt, er det for første gang en af de store amerikanske udbydere, der satser aktivt på open weights, netop når Meta går den anden vej.

For europæiske virksomheder er Gemma 4 interessant af tre grunde: licensen er enterprise-venlig, modellerne findes i flere størrelser inklusive en small language model-variant, der kan køres tæt på produktionsmiljøet, og Google markedsfører eksplicit sovereign cloud-setups, der imødekommer europæiske krav til dataplacering. Det er ikke nødvendigvis den rigtige løsning til alle, men det er et reelt enterprise-alternativ med en seriøs vedligeholdelsesplan.

Ved siden af Google er Mistral fortsat det klare europæiske signal. Franske Mistral har senest hentet store investeringer og er en af få leverandører, der kombinerer open-weight-modeller, europæisk jurisdiktion og en skalerbar kommerciel struktur. DeepSeek og Qwen, der begge kommer fra det kinesiske økosystem, leverer stærke reasoning- og multimodale modeller med lave omkostninger, men bør vurderes grundigt for leverandørrisiko, eksportkontrol og datasikkerhed, inden de lægges ind i kritiske workflows.

Vigtigt er det, at I ikke tænker „én ny favorit erstatter Llama“. Den post-Muse Spark-verden ser i praksis mere ud som en portefølje, hvor forskellige modeller bruges til forskellige opgaver. En mindre, hurtig model til klassifikation og RAG, en mellemstor til intern agent-brug og en frontier-model som ekstern API, når I virkelig har brug for top-reasoning. Det er også den struktur, som vendor-diversification-politikker lægger op til.

Den bredere kontekst: Open vs. closed er blevet en forsyningskæde-diskussion

Muse Spark-lanceringen skal ses sammen med to andre nyheder fra den samme uge. Google og Broadcom har ifølge rapporter fra CNBC udvidet deres chipaftaler og knyttet Anthropic tættere til Googles TPU-kapacitet i størrelsesordenen flere gigawatt. Samtidig er Anthropics annualiserede omsætning ifølge flere mediekilder vokset fra omkring 9 milliarder dollar i slutningen af 2025 til et niveau, der citeres omkring 30 milliarder dollar i foråret 2026. Både tallene og selve setup’et med store, langvarige compute-forpligtelser viser, at frontier-AI er ved at blive en kapitalintensiv industri, hvor adgang til GPU’er og TPU’er er blevet en lige så vigtig konkurrenceparameter som selve modellen. Det er også forklaringen på, at ingen af de tre store amerikanske labs i praksis længere giver deres bedste vægte væk gratis.

I det lys er spørgsmålet om open source vs. closed source ikke længere primært ideologisk. Det er et forsyningskæde-spørgsmål. Hvem kan levere compute i stor skala, hvem kan tåle at give vægtene væk gratis, og hvem kan bygge en forretning, der hænger sammen, når kunderne bliver mere prisfølsomme og mere regulerede? Meta har svaret med Muse Spark og Meta AI-distributionen. Google har svaret med Gemma 4 og sovereign cloud. Anthropic og OpenAI har svaret med compute-aftaler og fokus på API-omsætning.

For danske beslutningstagere betyder det, at jeres AI-leverandørvalg i stigende grad bliver et valg om, hvilken forsyningskæde I binder jer til. Det er ikke bare et spørgsmål om benchmarks eller pris pr. million tokens. Det er et spørgsmål om, hvem der ejer chippene, hvem der ejer vægtene, hvor data bliver opbevaret, og hvor robust leverandøren ser ud på fem års sigt. De spørgsmål tilhører ikke længere alene CTO’en. De hører også til i bestyrelsesrummet.

Tendensen genfindes også i markedet omkring jer. Dansk Erhverv har rapporteret, at en stigende andel af deres medlemsvirksomheder bruger AI-værktøjer, og Danmarks Statistik har tidligere vist, at danske virksomheder ligger et godt stykke over EU-gennemsnittet for AI-brug. Det betyder, at I ikke er alene med beslutningen, og at det valg, jeres konkurrenter træffer i 2026, vil forme branchens enterprise-stack de næste fem år.

Tre strategiske beslutninger, I bør træffe inden sommeren 2026

Det første skridt er en vendor-diversification-politik, der er mere end en note i en risikolog. Mange danske virksomheder har i praksis gjort Llama til deres default uden at skrive det ned, og det er den skjulte lås, Muse Spark afslører. En simpel politik kan indeholde et krav om, at kerneløsninger (kundeservice, intern viden, beslutningsstøtte) altid skal kunne køres på mindst to foundation models fra to forskellige leverandører, og at I mindst én gang om året kvalificerer nye kandidater. Det er billigt at skrive og dyrt at undvære.

Det andet skridt er en exit-strategi for eksisterende Llama-workloads. Det betyder ikke, at I skal pille Llama ud i næste sprint. Det betyder, at I skal vide, hvad det vil koste, hvis I er nødt til det. Start med et kort regneark: hvilke workloads kører på Llama, hvilken version, hvilket fine-tuning-datasæt, hvilken model deployment-opsætning, og hvad ville skulle ændres, hvis modellen skulle udskiftes med Gemma 4 eller Mistral? Når tallene er på bordet, er det lettere at prioritere hvilke dele, der kan vente, og hvilke der skal migreres først.

Det tredje skridt er et evaluation framework for jeres næste foundation model. Muse Spark-lanceringen gør det pludselig relevant at stille spørgsmål, som mange aldrig er kommet i nærheden af: Hvordan vurderer I modellens kvalitet på dansk? Hvilke data er modellen trænet på? Hvordan håndterer leverandøren opdateringer og deprecations? Hvad betyder modellen for jeres enterprise AI-stack i termer af latens, pris og databaner? Et enkelt evaluation framework gør fremtidige beslutninger hurtigere og mindre politiske, fordi I vurderer modeller efter de samme krav hver gang.

Endelig: Husk AI Act-perspektivet. Åbne modeller har ofte en lettere transparens-situation under Article 50 og GPAI-reglerne, fordi dokumentation, vægte og træningsbeskrivelser kan offentliggøres. Hvis jeres interne risk-team vejer open source hjem på governance alene, er Muse Spark ikke et argument for at rykke over i closed source. Det er et argument for, at „open“ skal forblive en del af porteføljen, også når de store navne ændrer strategi. Jo bedre I har styr på agentic AI-brug og multi-agent-arkitekturer i jeres egne systemer, jo mindre afhængige bliver I af én bestemt leverandørs strategiske kursskifte.

Kan du heller ikke følge med nyhedsstrømmen?

Det kan vi godt forstå, for hver uge bringer +20 nyheder! Du kan gøre som 1200+ andre profesionelle og modtage nyhederne direkte i din indbakke.

Blot udfyld formularen og du er med på holdet

Fortsæt læsningen

Stop med at bygge til den nuværende model: Sådan rider du kapabilitetskurven

Den 14. maj 2026 trykkede Jarred Sumner på merge-knappen til en pull request, der tilføjede over én million linjer Rust til Bun, JavaScript-…

Antigravity 2.0: 93 agenter byggede et OS på 12 timer

Google lancerede Antigravity 2.0 på I/O 2026, en selvstændig desktopapplikation, der sætter AI-agenter i centrum af softwareudvikling. Under…

Gemma 4 fra Google I/O 2026: Open-weight modeller er voksne nu

Google DeepMind fremlagde i denne uge en samlet pakke for Gemma 4-familien, der hæver baren for, hvad du kan bygge med åbne modeller. En mod…